Adressage IP

L’adressage IP est un système utilisé pour identifier et localiser des dispositifs connectés à un réseau informatique. Chaque appareil sur un réseau IP est identifié par une adresse IP unique, qui est composée d’une série de numéros qui indiquent sa position dans le réseau.

Les adresses IP sont divisées en deux parties : l’adresse réseau et l’adresse hôte. L’adresse réseau identifie le réseau auquel appartient l’appareil, tandis que l’adresse hôte identifie l’appareil spécifique sur ce réseau.

Il existe deux versions principales du protocole IP : IPv4 et IPv6. IPv4 utilise des adresses IP de 32 bits et peut identifier environ 4 milliards d’appareils sur un réseau, tandis qu’IPv6 utilise des adresses IP de 128 bits et peut identifier un nombre pratiquement illimité d’appareils.

L’adressage IP est utilisé dans de nombreux aspects des réseaux informatiques, notamment pour la communication entre les ordinateurs, la transmission de données sur Internet, et la gestion des pare-feux et des routeurs.

IP Publique / Privée

L’adressage IP peut être classé en deux catégories : les adresses IP privées et les adresses IP publiques.

Les adresses IP privées sont utilisées pour les dispositifs sur un réseau local (LAN) et ne sont pas routées sur l’Internet public. Les adresses IP privées sont fournies gratuitement par les routeurs domestiques et les points d’accès WiFi pour permettre aux dispositifs de communiquer entre eux au sein d’un réseau local. Les adresses IP privées sont généralement utilisées pour les réseaux domestiques et de bureau et commencent par l’un des blocs d’adresses suivants : 10.0.0.0 à 10.255.255.255, 172.16.0.0 à 172.31.255.255, ou 192.168.0.0 à 192.168.255.255.

Les adresses IP publiques, en revanche, sont utilisées pour les dispositifs qui doivent être accessibles depuis Internet et peuvent être routées sur le réseau public. Les adresses IP publiques sont fournies par les fournisseurs d’accès Internet (FAI) et sont nécessaires pour accéder à Internet et pour que les serveurs et autres dispositifs soient accessibles depuis l’extérieur du réseau local. Les adresses IP publiques sont uniques et ne peuvent pas être dupliquées sur Internet. Les adresses IP publiques sont limitées et leur disponibilité est gérée par les autorités de réglementation Internet.

En résumé, les adresses IP privées sont utilisées pour les dispositifs qui communiquent entre eux sur un réseau local, tandis que les adresses IP publiques sont utilisées pour les dispositifs qui doivent être accessibles depuis Internet. Les adresses IP privées sont gratuites et fournies par les routeurs domestiques, tandis que les adresses IP publiques sont fournies par les FAI et nécessitent souvent un abonnement et des frais supplémentaires.

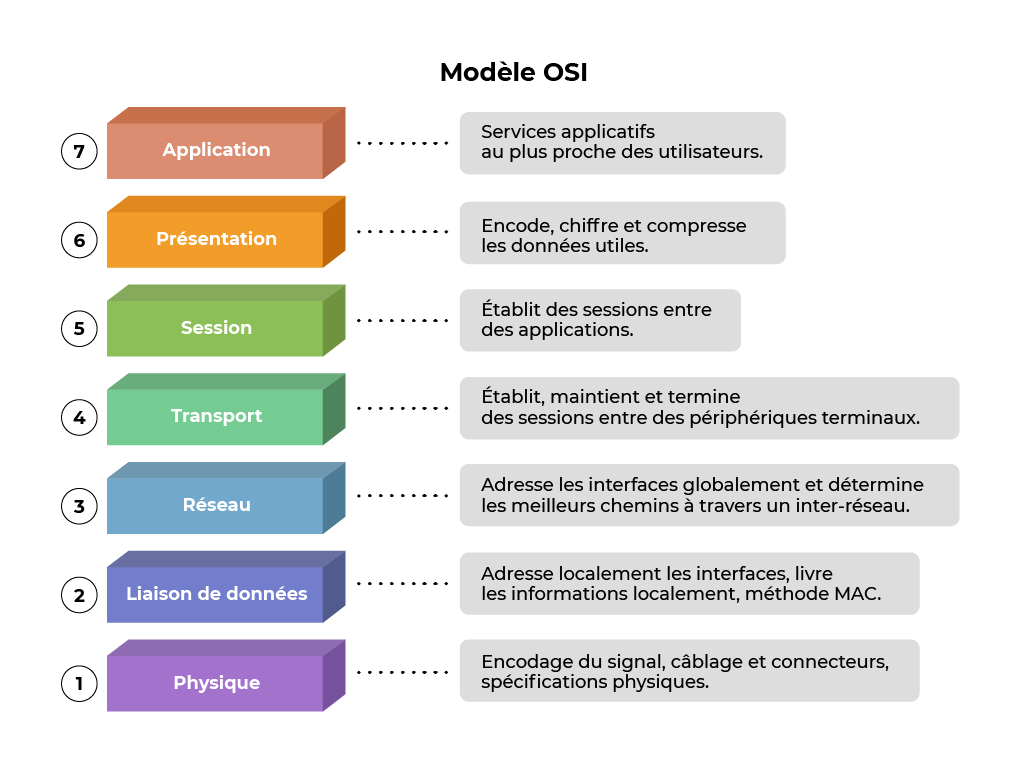

Modèle OSI

Le modèle OSI (Open Systems Interconnection) est un modèle de référence qui décrit les étapes de communication entre des ordinateurs ou des dispositifs connectés à un réseau. Il a été développé par l’Organisation Internationale de Normalisation (ISO) dans les années 1980 et est considéré comme un cadre de référence pour la conception et le développement de réseaux informatiques.

Le modèle OSI est constitué de sept couches, chacune décrivant une fonction spécifique dans le processus de communication entre les dispositifs sur un réseau. Les couches du modèle OSI sont :

- La couche physique : elle définit les caractéristiques physiques et électriques de la connexion réseau.

- La couche liaison de données : elle gère la transmission des données sur la couche physique en fournissant des fonctionnalités de contrôle d’erreur, de correction et de contrôle de flux.

- La couche réseau : elle gère le routage des paquets de données à travers le réseau.

- La couche transport : elle fournit un transfert de données fiable et contrôle la congestion du réseau.

- La couche session : elle établit, gère et termine les connexions entre les applications.

- La couche présentation : elle gère la représentation des données pour les applications, en convertissant les données dans un format approprié pour l’envoi sur le réseau.

- La couche application : elle fournit des services de communication aux applications, telles que la messagerie électronique, la navigation web et le partage de fichiers.

Le modèle OSI est utile pour la conception et le dépannage des réseaux informatiques, car il fournit une vue d’ensemble des différentes couches impliquées dans la communication sur un réseau. Les protocoles de communication réseau, tels que TCP/IP, sont conçus en utilisant une approche basée sur le modèle OSI.

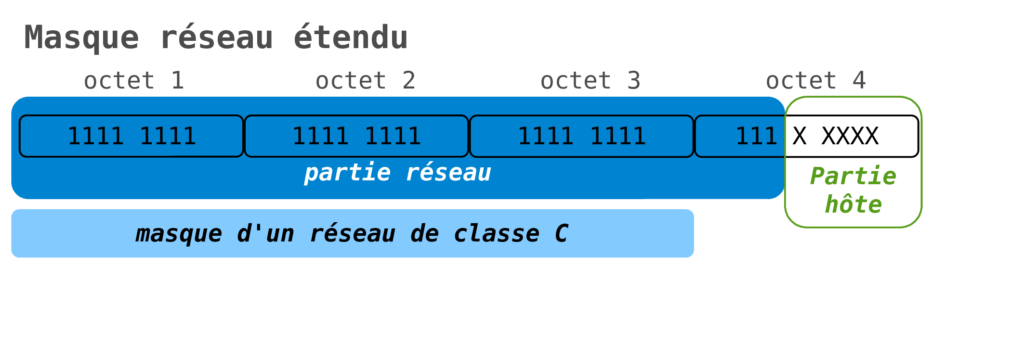

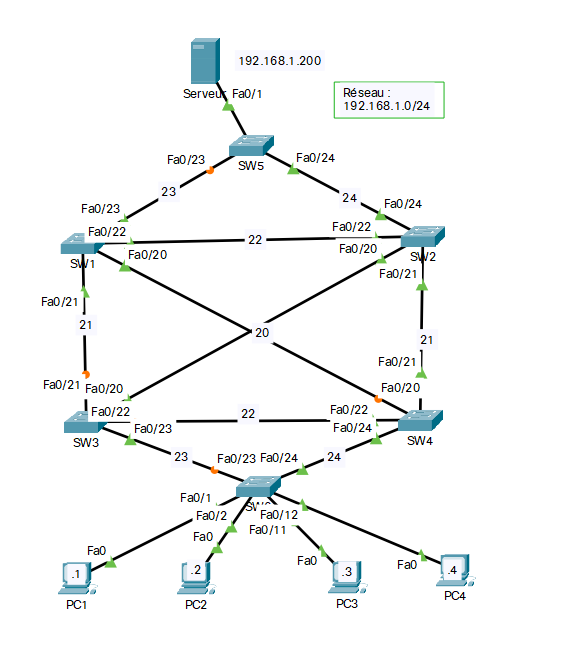

Sous-réseaux, subdivision VLSM

Comprendre les sous-réseaux Un sous-réseau est un réseau logique distinct qui existe au sein d’un réseau physique plus grand. Les sous-réseaux permettent de diviser un réseau en segments plus petits, ce qui peut améliorer la sécurité en limitant la propagation des paquets de données indésirables, ainsi que faciliter la gestion en permettant de limiter la portée des opérations de dépannage et de maintenance. Les sous-réseaux peuvent également améliorer l’efficacité en réduisant le nombre de paquets qui doivent être transmis sur un réseau physique plus grand.

Les sous-réseaux sont généralement créés en divisant un réseau en segments de tailles égales. Par exemple, un réseau avec une adresse IP de classe C (qui fournit 256 adresses) pourrait être divisé en quatre sous-réseaux avec chacun 64 adresses. Cependant, cette méthode de subdivision peut entraîner un gaspillage d’adresses IP, car certaines sous-réseaux peuvent avoir besoin de plus ou moins d’adresses que d’autres.

Comprendre la subdivision VLSM La subdivision VLSM est une méthode de sous-réseau qui permet de diviser un réseau en sous-réseaux de tailles différentes. Avec la subdivision VLSM, les adresses IP peuvent être allouées en fonction des besoins spécifiques de chaque sous-réseau, plutôt que de manière uniforme pour tous les sous-réseaux.

Par exemple, supposons que vous ayez un réseau avec une adresse IP de classe C (qui fournit 256 adresses) et que vous souhaitez diviser ce réseau en trois sous-réseaux. Le premier sous-réseau doit être en mesure d’accueillir 100 hôtes, le deuxième doit en accueillir 50 et le troisième doit en accueillir 6. Avec la subdivision VLSM, vous pouvez allouer des blocs d’adresses IP de différentes tailles à chaque sous-réseau, en fonction de ses besoins.

Dans cet exemple, vous pourriez allouer un bloc de 128 adresses IP pour le premier sous-réseau, ce qui lui permettrait de satisfaire ses besoins. Pour le deuxième sous-réseau, vous pourriez allouer un bloc de 64 adresses IP, ce qui est suffisant pour répondre à ses besoins. Enfin, pour le troisième sous-réseau, vous pouvez allouer un bloc de 8 adresses IP, ce qui est également suffisant pour répondre à ses besoins.

La subdivision VLSM permet donc une utilisation plus efficace des adresses IP disponibles, car elle permet de diviser un réseau en sous-réseaux de tailles différentes, en fonction des besoins de chaque sous-réseau.

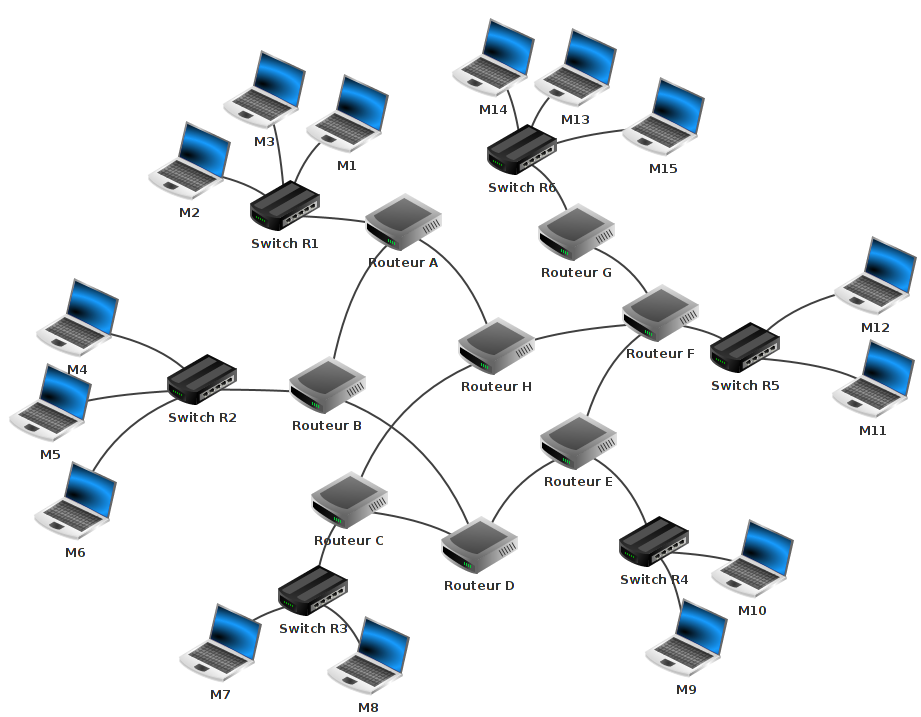

Exemple de sous-réseaux :

| Adresse sous réseau | Masque de sous réseau | 1ère adresse | Dernière adresse | Adresse broadcast |

| 172.20.0.0/21 | 255.255.248.0 | 172.20.0.1 | 172.20.7.254 | 172.20.7.255 |

| 172.20.8.0/21 | 255.255.248.0 | 172.20.8.1 | 172.20.15.254 | 172.20.15.255 |

| 172.20.16.0/21 | 255.255.248.0 | 172.20.16.1 | 172.20.23.254 | 172.20.23.255 |

| 172.20.24.0/21 | 255.255.248.0 | 172.20.24.1 | 172.20.31.254 | 172.20.31.255 |

| 172.20.32.0/21 | 255.255.248.0 | 172.20.32.1 | 172.20.39.254 | 172.20.39.255 |

| … | … | … | … | … |

| 172.20.248.0/21 | 255.255.248.0 | 172.20.248.1 | 172.20.255.254 | 172.20.255.255 |

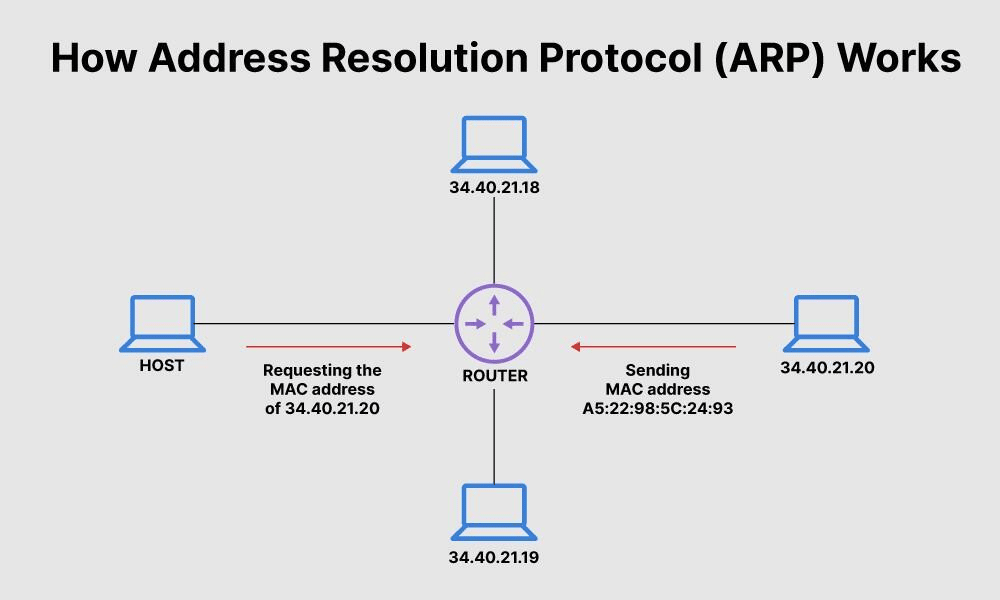

Protocole ARP

Lorsqu’un dispositif souhaite envoyer des données à une autre adresse IP sur le réseau, il utilise ARP pour trouver l’adresse MAC de cette adresse IP. La requête ARP est envoyée à l’ensemble du réseau local, demandant à tous les dispositifs qui ont l’adresse IP demandée de répondre avec leur adresse MAC. Le dispositif destinataire répond avec son adresse MAC, et le dispositif émetteur utilise ensuite cette adresse pour envoyer les données.

Le protocole ARP (Address Resolution Protocol) est un protocole de couche liaison de données qui permet à un dispositif sur un réseau de trouver l’adresse MAC (Media Access Control) correspondante à une adresse IP donnée.

Le protocole ARP est utilisé pour simplifier la communication entre les dispositifs sur un réseau local, car il permet à chaque dispositif de trouver rapidement les adresses MAC des autres dispositifs avec lesquels il communique. Il est important de noter que les adresses MAC sont utilisées sur la couche liaison de données du modèle OSI, tandis que les adresses IP sont utilisées sur la couche réseau.

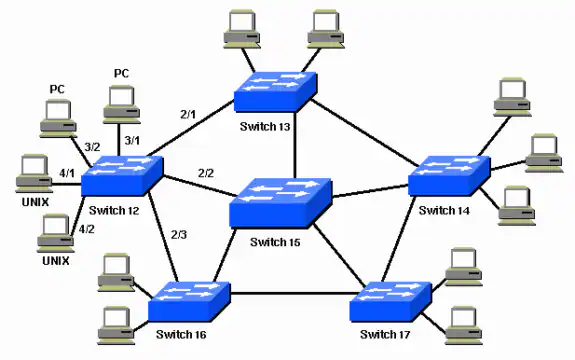

Protocole STP

STP signifie « Spanning Tree Protocol » (protocole de l’arbre couvrant en français). Il s’agit d’un protocole de réseau informatique qui permet de prévenir les boucles de commutation en désactivant les liens redondants dans un réseau Ethernet. Les boucles de commutation peuvent se produire dans un réseau lorsque plusieurs chemins sont disponibles pour envoyer des données entre des appareils, ce qui peut entraîner des collisions et des temps d’arrêt du réseau.

Le STP est un protocole standardisé par l’Institute of Electrical and Electronics Engineers (IEEE) et il est utilisé dans de nombreux réseaux d’entreprise pour assurer une connectivité fiable et résiliente. Il fonctionne en élisant un commutateur racine et en désactivant les liens redondants pour créer un arbre couvrant unique qui connecte tous les appareils du réseau.

Si un lien de connexion du réseau échoue, le STP peut automatiquement réorganiser le réseau en utilisant les liens redondants disponibles pour éviter les boucles et assurer une connectivité continue.

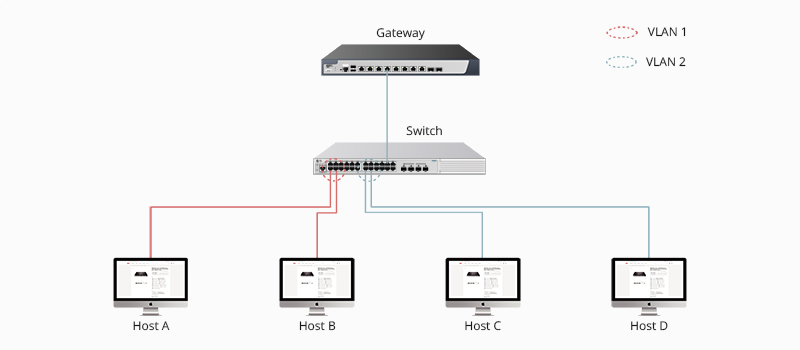

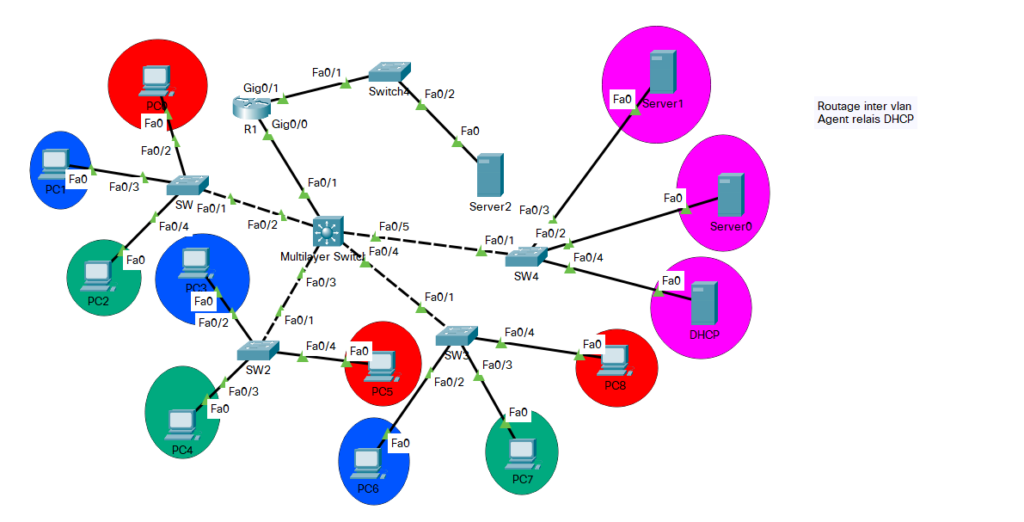

VLAN, Routage Inter-VLAN

Un VLAN (Virtual Local Area Network) est un réseau local virtuel qui permet de segmenter un réseau physique en plusieurs sous-réseaux logiques. Les VLANs sont utilisés pour séparer les flux de trafic réseau, améliorer la sécurité, optimiser la bande passante et simplifier la gestion du réseau.

Le routage Inter-VLAN est une technique qui permet à différents VLANs de communiquer entre eux. En effet, par défaut, les VLANs sont isolés les uns des autres et ne peuvent pas communiquer directement. Le routage Inter-VLAN permet de connecter les différents VLANs entre eux à l’aide d’un routeur ou d’un commutateur capable de gérer des VLANs.

Pour mettre en place un routage Inter-VLAN, il est nécessaire de créer des interfaces de sous-réseaux virtuels (SVI) sur le routeur ou le commutateur, une pour chaque VLAN. Chaque interface SVI est associée à un VLAN spécifique et permet de router le trafic entre les différents VLANs.

Le routage Inter-VLAN est utilisé pour de nombreuses applications, notamment pour isoler des groupes d’utilisateurs sur des réseaux privés distincts, pour améliorer la sécurité en limitant l’accès aux ressources sensibles, ou pour optimiser les performances du réseau en réduisant la charge sur les liens de communication entre les différents VLANs.

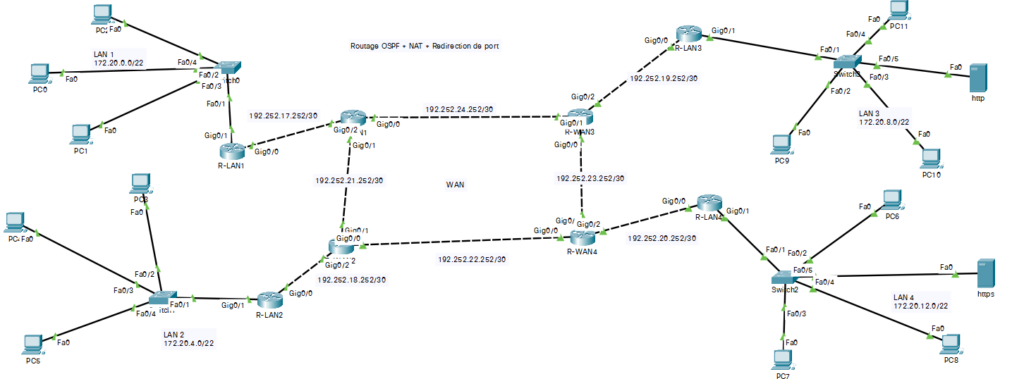

Routage, NAT, Redirection de port

Le routage, le NAT (Network Address Translation) et la redirection de port sont des concepts clés en matière de mise en réseau informatique.

Le routage est le processus qui permet de diriger les paquets de données entre différents réseaux informatiques en fonction de leur adresse IP de destination. Un routeur est un équipement qui assure le routage des données entre différents réseaux en se basant sur des tables de routage qui indiquent la meilleure route pour acheminer les paquets.

Le NAT est une technique qui permet de traduire les adresses IP privées utilisées dans un réseau local en adresses IP publiques utilisées sur internet. Cette technique est utilisée pour permettre à plusieurs ordinateurs d’un même réseau local d’accéder à internet à partir d’une seule adresse IP publique. Le NAT est également utilisé pour renforcer la sécurité en masquant les adresses IP privées derrière une adresse IP publique.

La redirection de port est une technique qui permet de diriger les paquets de données qui arrivent sur un port spécifique d’une adresse IP vers un autre port ou une autre adresse IP. Cette technique est utilisée pour permettre à des applications ou des services qui utilisent des ports spécifiques (par exemple, un serveur web qui utilise le port 80) d’être accessibles depuis internet, même si le réseau utilise un NAT. La redirection de port est également utilisée pour rediriger le trafic vers des serveurs spécifiques dans un réseau interne.

En résumé, le routage permet de diriger les paquets de données entre différents réseaux, le NAT permet de traduire les adresses IP pour permettre l’accès à internet, et la redirection de port permet de rediriger le trafic vers des ports spécifiques ou des adresses IP. Ces techniques sont essentielles pour assurer le bon fonctionnement et la sécurité des réseaux informatiques.

Filtrage

Le filtrage est une technique de sécurité qui permet de contrôler l’accès à un réseau ou à un système en limitant les communications entrantes et sortantes. Il existe plusieurs méthodes de filtrage, dont les plus courantes sont les ACL (Listes de Contrôle d’Accès), les pare-feux et iptables.

Les ACL sont des listes qui spécifient les conditions et les règles d’accès autorisées ou refusées pour un utilisateur, une adresse IP ou un protocole spécifique. Les ACL sont souvent utilisées pour contrôler l’accès aux routeurs et aux commutateurs, en spécifiant les adresses IP et les protocoles qui sont autorisés à traverser le dispositif. Par exemple, une ACL peut être utilisée pour autoriser ou refuser l’accès à un réseau privé à partir d’une adresse IP spécifique.

Les pare-feux sont des dispositifs de sécurité qui permettent de filtrer les paquets de données entrants et sortants sur un réseau. Ils utilisent des règles de filtrage pour autoriser ou refuser le trafic en fonction de l’adresse IP, du port et du protocole. Les pare-feux sont souvent utilisés pour protéger les réseaux locaux et les systèmes informatiques contre les attaques externes.

Iptables est un pare-feu logiciel qui est intégré au noyau Linux. Il permet de configurer des règles de filtrage pour contrôler l’accès aux ports TCP/UDP et aux protocoles ICMP. Iptables est très flexible et peut être utilisé pour mettre en place des règles de filtrage avancées.

En résumé, le filtrage est une technique de sécurité qui permet de contrôler l’accès à un réseau ou à un système en limitant les communications entrantes et sortantes. Les ACL, les pare-feux et iptables sont des outils couramment utilisés pour mettre en place des règles de filtrage.

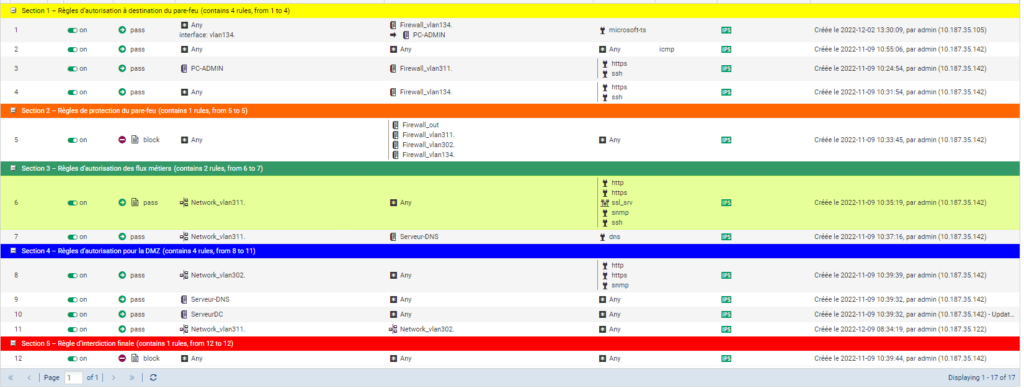

Exemple de filtrage :

Haute disponibilité HSRP

HSRP (Hot Standby Router Protocol) est un protocole de routage redondant utilisé dans les réseaux informatiques pour assurer une haute disponibilité des routeurs.

HSRP permet de configurer deux ou plusieurs routeurs pour travailler ensemble en tant que groupe virtuel pour partager une adresse IP virtuelle unique. L’adresse IP virtuelle est utilisée comme passerelle par défaut par les autres appareils connectés au réseau.

L’un des routeurs est désigné comme routeur actif (active router) et est responsable de la gestion du trafic réseau. Les autres routeurs sont en mode veille (standby) et sont prêts à prendre le relais en cas de défaillance du routeur actif.

HSRP utilise des messages de protocole pour permettre aux routeurs de se synchroniser et de déterminer lequel est l’actif et lequel est en veille. Si le routeur actif tombe en panne, l’un des routeurs en veille prendra automatiquement la relève pour assurer une continuité de service.

HSRP est souvent utilisé dans les réseaux locaux pour assurer une haute disponibilité des passerelles par défaut et pour réduire le temps de reprise en cas de panne du routeur actif.

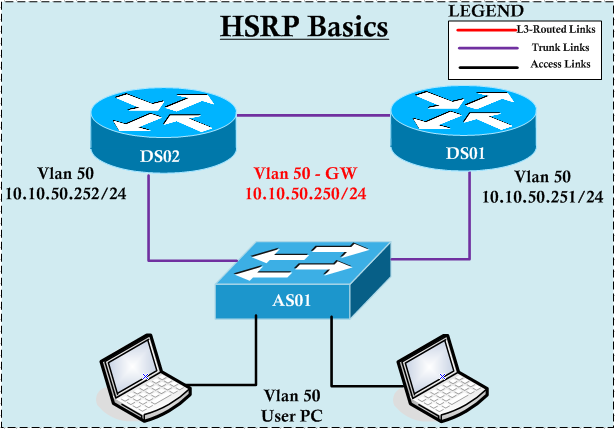

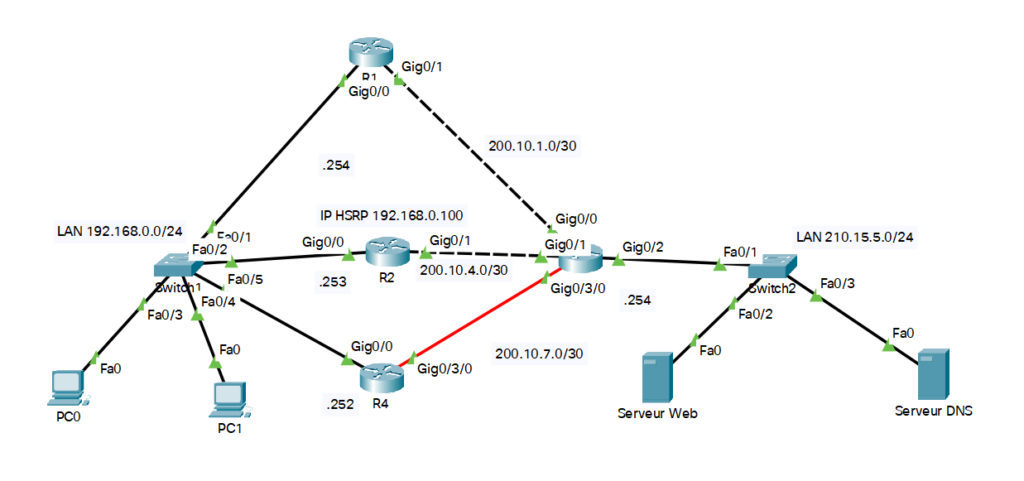

Maquette utilisant le protocole HSRP :

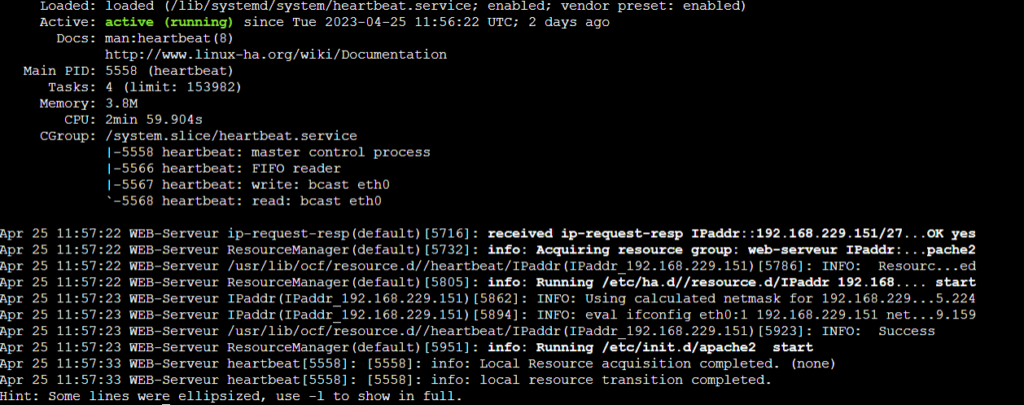

Haute disponibilité Heartbeat

Heartbeat est un programme ou un protocole qui permet de surveiller l’état de fonctionnement d’un système informatique ou d’un réseau. Il est généralement utilisé pour détecter les pannes et les erreurs, ainsi que pour vérifier si un service ou une application est disponible et répond.

En général, Heartbeat envoie des signaux de test ou des requêtes à un serveur, à une application ou à un équipement réseau pour vérifier son état. Si un signal de réponse est reçu dans un délai donné, le système est considéré comme étant en état de fonctionnement normal. Si aucun signal n’est reçu ou si le signal reçu indique une erreur ou un dysfonctionnement, des actions peuvent être prises pour résoudre le problème, telles que le redémarrage d’un service, l’envoi d’une notification à un administrateur système ou la mise en place d’une solution de secours.

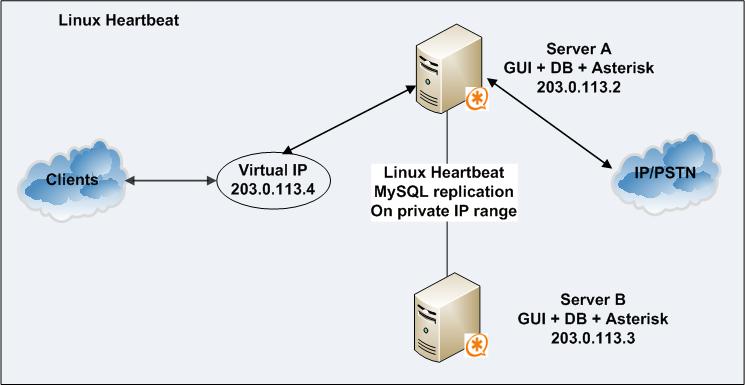

Heartbeat est largement utilisé dans les environnements informatiques, tels que les centres de données, les systèmes de surveillance de réseau, les systèmes de messagerie électronique, les serveurs web, etc. Il existe également des logiciels spécifiques appelés « moniteurs de heartbeat » qui sont utilisés pour surveiller les services et les applications critiques.